Capítulo 1. Mitos y realidades de la IA

Este trabajo se ha traducido utilizando IA. Agradecemos tus opiniones y comentarios: translation-feedback@oreilly.com

Pamela McCorduck, en su libro Máquinas que piensan (W. H. Freeman), describe la IA como un "audaz esfuerzo por duplicar en un artefacto" lo que todos consideramos nuestro atributo más definitorio: la inteligencia humana. Su libro de 1979 ofrece una visión fascinante de las primeras ideas sobre la IA, sin utilizar teoremas ni ciencia, sino describiendo cómo la gente llegó a imaginar sus posibilidades. Con algo tan mágico y asombroso como la IA, no es difícil imaginar la hipérbole que la rodea. Este capítulo pretende mantener el asombro, pero basándolo en la realidad.

Stuart Russell, informático y uno de los pensadores en IA más importantes del siglo XXI, analiza el pasado, el presente y el futuro de la IA en su libro Human Compatible (Viking). Russell escribe que la IA se está convirtiendo rápidamente en un aspecto omnipresente de la actualidad y será la tecnología dominante del futuro. Quizá en ningún sector, salvo en el de la sanidad, sea esto tan cierto, y esperamos abordar las implicaciones de ello en este libro.

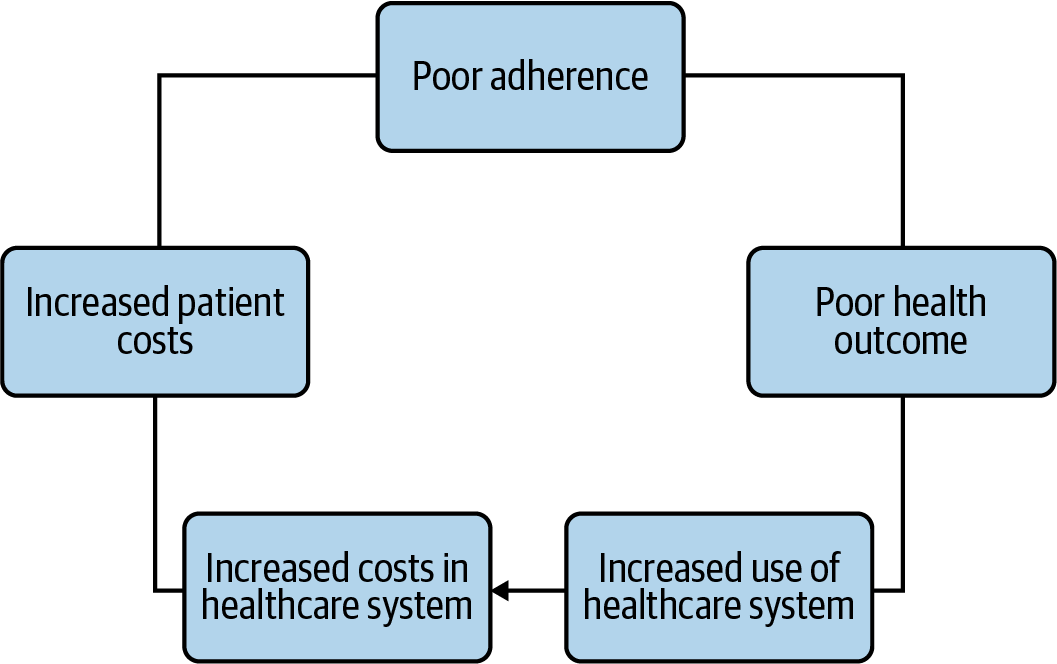

Para la mayoría de la gente, el término inteligencia artificial evoca una serie de propiedades y capacidades atribuidas, algunas reales, muchas futuristas y otras imaginarias. La IA tiene varios superpoderes, pero no es una "bala de plata" que vaya a resolver el aumento vertiginoso de los costes sanitarios y la creciente carga de la enfermedad. Dicho esto, el uso reflexivo de la IA en la atención sanitaria crea una enorme oportunidad para ayudar a las personas a llevar una vida más sana y, al hacerlo, controlar algunos costes sanitarios y obtener mejores resultados. En este capítulo se describen los mitos sanitarios y tecnológicos que rodean a la IA, como preludio al debate sobre cómo las aplicaciones, los sistemas, los procesos y las plataformas mejorados por la IA proporcionan enormes ventajas en calidad, rapidez, eficacia, coste y capacidad, permitiendo a los médicos centrarse en las personas y en su atención sanitaria.

Gran parte del bombo que acompaña a la IA se debe al rendimiento de los modelos de aprendizaje automático en comparación con el de las personas, a menudo médicos. Abundan los artículos y algoritmos que describen modelos de aprendizaje automático que superan a los humanos en diversas tareas, desde el reconocimiento de imágenes y voz hasta el procesamiento del lenguaje y las predicciones. Esto plantea la cuestión de si los diagnosticadores de aprendizaje automático (AM) se convertirán en la norma. Sin embargo, el rendimiento de estos modelos en la práctica clínica a menudo difiere de su rendimiento en el laboratorio; los modelos de aprendizaje automático construidos con datos de entrenamiento y de prueba a veces no consiguen el mismo éxito en áreas como la detección de objetos (por ejemplo, identificar un tumor) o la predicción de enfermedades. Los datos del mundo real son diferentes -es decir, los datos de entrenamiento no coinciden con los datos del mundo real- y esto provoca un desplazamiento de los datos. Por ejemplo, algo tan simple como la variación en los tipos de piel podría hacer que un modelo entrenado en el laboratorio perdiera precisión en un entorno clínico. Los diagnosticadores ML pueden ser nuestro futuro, pero deben producirse innovaciones adicionales para que los diagnosticadores algorítmicos se conviertan en una realidad.

La hipérbole y los mitos que han surgido en torno a la IA desdibujan el arte de lo que es posible con la IA. Antes de hablar de esos mitos, entendamos qué entendemos por IA. Abundan las descripciones de la IA, pero la utilidad de la IA será más importante que una definición. Gran parte de este libro explorará el servicio de la IA. Aportamos claridad para ayudar a comprender el contexto y el significado del término IA. Una breve mirada a su origen proporciona un marco útil para comprender cómo se entiende y utiliza la IA en la actualidad.

Orígenes y definición de la IA

Los humanos imaginan el arte de lo que es posible con la vida artificial y las máquinas desde hace siglos. En su libro de 2018 Gods and Robots (Dioses y Robots ) (Princeton University Press), Adrienne Mayor, investigadora, pinta un cuadro de los humanos imaginando la vida artificial en los primeros años de la historia registrada. Escribe sobre antiguos sueños y mitos en los que la tecnología mejoraba a los humanos. Unos miles de años más tarde, en 1943, dos investigadores del área de Chicago introdujeron la noción de redes neuronales en un artículo que describía un modelo matemático. Los dos investigadores -un neurocientífico, Warren S. McCulloch, y un lógico, Walter Pitts- intentaron explicar cómo funcionan los complejos procesos de decisión del cerebro humano utilizando las matemáticas. Fue el nacimiento de las redes neuronales y de la inteligencia artificial tal como la conocemos.

Décadas más tarde, en un pequeño pueblo junto al río Connecticut, en New Hampshire, cuelga una placa en Dartmouth Hall, que conmemora un proyecto de investigación de verano de 1956, una sesión de intercambio de ideas llevada a cabo por matemáticos y científicos. Los nombres de los padres fundadores de la IA están grabados en la placa, reconociéndoles sus contribuciones durante esa sesión de verano, que fue la primera vez que se utilizaron las palabras "inteligencia artificial"; John McCarthy, ampliamente conocido como el padre de la IA, se lleva el mérito de acuñar el término.

Los asistentes a la sesión de verano de Dartmouth imaginaron la inteligencia artificial como ordenadores que hacen cosas que nosotros percibimos como muestras de inteligencia humana. Debatieron ideas que iban desde ordenadores que entienden el habla humana hasta máquinas que funcionan como el cerebro humano, utilizando neuronas. ¿Qué mejor muestra de inteligencia que los dispositivos capaces de hablar y comprender el lenguaje humano, lo que ahora se conoce como procesamiento del lenguaje natural? Durante esta sesión de verano, los fundadores de la IA se inspiraron en cómo funciona el cerebro humano al transmitir información entre los receptores de entrada, las neuronas y la materia cerebral profunda. En consecuencia, surgió la idea de utilizar neuronas artificiales como técnica para imitar el cerebro humano.

Abundan el entusiasmo y las promesas de transformación de la asistencia sanitaria, pero este objetivo sigue siendo difícil de alcanzar. En la década de 1960, la comunidad de la IA introdujo los sistemas expertos, que intentan transferir los conocimientos de un experto (por ejemplo, un médico) a los ordenadores mediante reglas y luego aplicarlas a una base de conocimientos para deducir nueva información, una inferencia. En los años 70, los sistemas basados en reglas como MYCIN, un sistema de IA diseñado para tratar infecciones sanguíneas, eran muy prometedores. MYCIN intentaba diagnosticar a los pacientes utilizando sus síntomas y los resultados de las pruebas clínicas. Aunque sus resultados eran mejores o comparables a los de los especialistas en infecciones sanguíneas, su uso en la práctica clínica no llegó a materializarse. Otro sistema experto médico, CADUCEUS, intentó mejorar a MYCIN. MYCIN, CADUCEUS y otros sistemas expertos (como INTERNIST-I) ilustran los esfuerzos de la comunidad de IA por crear herramientas de diagnóstico clínico, pero ninguno de estos sistemas llegó a la práctica clínica.

Esta situación persiste hoy en día; la IA en la asistencia sanitaria no se encuentra fácilmente en la cabecera clínica. Varios trabajos de investigación demuestran que la IA rinde mejor que los humanos en tareas como el diagnóstico de enfermedades. Por ejemplo, los algoritmos de aprendizaje profundo superan a los radiólogos en la detección de tumores malignos. Sin embargo, estos algoritmos "superiores" de detección de enfermedades permanecen en gran medida en los laboratorios. ¿Tendrán estas herramientas de diagnóstico de aprendizaje automático el mismo destino que los sistemas expertos del siglo XX? ¿Tendrán que pasar muchos años antes de que la IA aumente sustancialmente el número de humanos en los entornos clínicos?

No estamos en los años 70; la IA impregna ahora la asistencia sanitaria de diversas maneras, en la producción, por ejemplo. La inteligencia artificial ayuda a los investigadores en la creación de fármacos para diversas enfermedades, como el cáncer. El Centro Médico Beth Israel Deaconess, hospital docente de la Facultad de Medicina de Harvard, utiliza la IA para diagnosticar posibles enfermedades terminales de la sangre. Utiliza microscopios mejorados con IA para escanear en busca de bacterias nocivas como la E. coli en muestras de sangre, trabajando a un ritmo más rápido que el escaneo manual. El procesamiento del lenguaje natural se utiliza ampliamente para automatizar la extracción y codificación de datos clínicos de las notas de los médicos. Múltiples herramientas que funcionan hoy en día en entornos de producción utilizan el procesamiento del lenguaje natural para la codificación clínica. El aprendizaje automático ayuda a dirigir a los pacientes a los proveedores óptimos. Durante décadas, el aprendizaje automático se ha utilizado para identificar el fraude y reducir el despilfarro. La adopción generalizada de la IA en casos de uso específicos en empresas sanitarias, junto con las recientes innovaciones en IA, es muy prometedora para ampliar el uso de la IA en entornos clínicos.

Este libro sobre la asistencia sanitaria AI-First espera mostrar un futuro diferente para la adopción generalizada de la IA en la asistencia sanitaria, tanto en entornos clínicos como en los hogares de las personas. Sigue habiendo una conversación activa entre clínicos y tecnólogos sobre la implantación de la IA en la asistencia sanitaria. En un simposio celebrado en 2019, al que asistieron médicos, responsables políticos, profesionales sanitarios e informáticos, se expusieron ejemplos reales del paso de la IA del laboratorio a la clínica.1 El simposio destacó tres temas para el éxito: la planificación del ciclo de vida, la participación de las partes interesadas y la contextualización de los productos y herramientas de IA en los flujos de trabajo existentes.

Mucho ha cambiado en los años transcurridos desde la concepción de las redes neuronales en 1943. La IA sigue evolucionando cada década, lo que explica por qué el consenso sobre una definición de IA sigue siendo difícil de alcanzar. Como no todos operamos con la misma definición, hay mucha confusión en torno a lo que es y lo que no es la IA. Cómo se defina la inteligencia artificial puede depender de quién ofrezca la explicación, del contexto y de la razón para ofrecer una definición. La IA es un término amplio que representa nuestra intención de construir entidades inteligentes similares a los humanos para tareas seleccionadas. El objetivo es utilizar campos de la ciencia, las matemáticas y la tecnología para imitar o replicar la inteligencia humana con máquinas, y a esto lo llamamos "IA". En este libro, exploraremos varias entidades inteligentes, como médicos aumentados, máquinas de predicción, espacios de atención virtual, etc., que mejoran los resultados de la asistencia sanitaria, la atención al paciente, las experiencias y el coste.

¡Seguimos construyendo y exhibiendo sistemas, máquinas y ordenadores que pueden hacer lo que antes entendíamos que sólo podían hacer los humanos: ganar a las damas, derrotar a un actual maestro mundial de ajedrez, superar a los concursantes más ganadores de Jeopardy! Famosamente, el programa informático AlphaGo ha derrotado a campeones mundiales en el juego de estrategia abstracta Go, de 4.000 años de antigüedad, y destaca en la emulación (y superación) del rendimiento humano en este juego. Abundan los artículos sobre modelos de aprendizaje automático en laboratorios que superan a los médicos en determinadas tareas, como la identificación de posibles tumores cancerosos en estudios de imagen; esto sugiere que la IA podría acabar sustituyendo a algunas especialidades médicas, como la de radiólogo.

IA y aprendizaje automático

Un principio del mensaje central de este libro es que la inteligencia artificial comprende algo más que el aprendizaje automático. Si pensamos en la IA únicamente en el contexto del ML, es dudoso que lleguemos a construir sistemas inteligentes que reflejen la inteligencia humana en la realización de actividades clínicas o sanitarias, o que creemos una IA que mejore materialmente las experiencias de los pacientes, reduzca los costes y mejore la salud de las personas y la calidad de vida de los trabajadores sanitarios.

La mayoría de las implementaciones publicitadas de IA muestran éxitos de modelos de ML, lo que explica por qué muchos ven una equivalencia entre el aprendizaje automático y la IA. Además, las aplicaciones de IA más comunes que utilizan el aprendizaje profundo, la visión por ordenador o el procesamiento del lenguaje natural emplean todas aprendizaje automático.

La suposición de que el aprendizaje automático es lo mismo que la IA ignora o descarta los aspectos de una pila de software utilizada para construir sistemas inteligentes que no son aprendizaje automático. O peor aún, nuestra imaginación o conocimiento de lo que es posible con la IA se limita sólo a las funciones implementables por el aprendizaje automático.

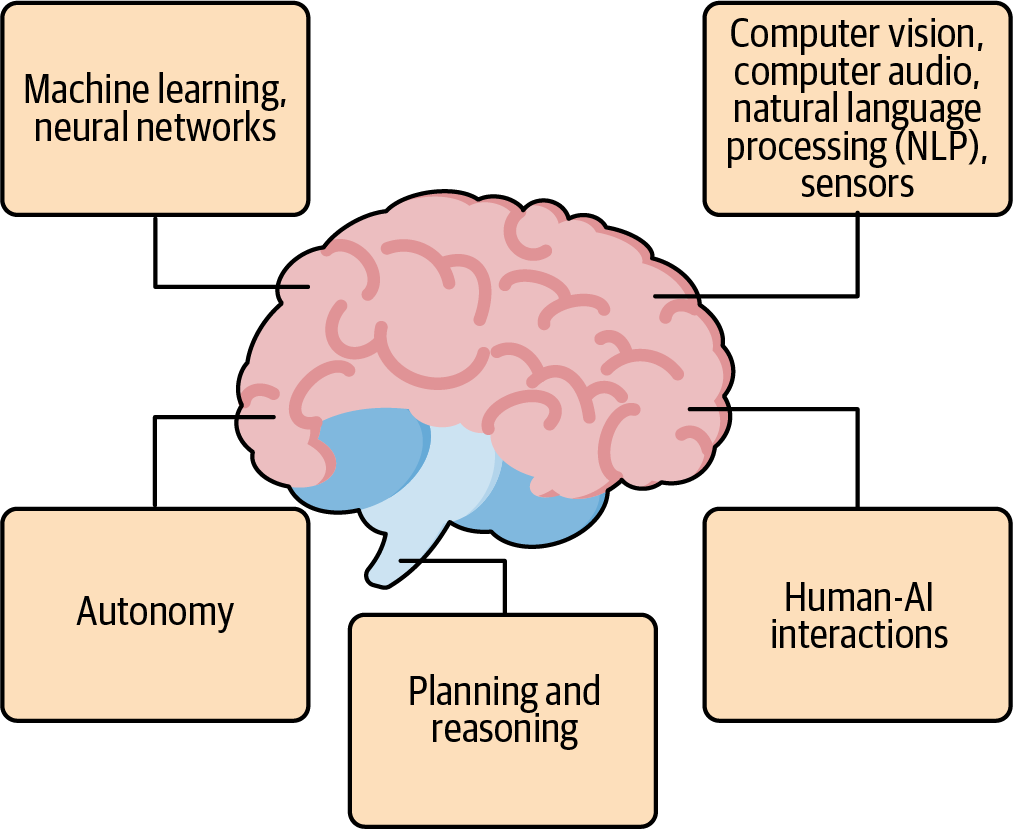

La IA comprende muchos de los componentes de la Pila de IA de la Figura 1-1, que ilustra las muchas capacidades de la IA más allá del aprendizaje automático.

Figura 1-1. Pila de IA

La aspiración de la IA de crear máquinas que exhiban una inteligencia similar a la humana requiere algo más que una capacidad de aprendizaje. Esperamos y necesitamos las múltiples capacidades de la IA para la ingeniería de soluciones sanitarias que se ilustran en la Figura 1-1. Transformar la asistencia sanitaria con IA implica funciones de visión por ordenador, lenguaje, audio, razonamiento y planificación. Para algunos problemas, podemos optar por dar autonomía a la IA; en nuestro debate sobre ética, más adelante en el libro, abordamos las implicaciones y los riesgos de hacerlo.

Las características de la IA en una implementación variarán en función del problema de que se trate. Por ejemplo, en una UCI, puede que queramos que la IA tenga capacidad de audio para permitir la capacidad de preguntas y respuestas entre la IA y los clínicos. Un clínico en conversación con la IA requiere habilidades lingüísticas en la IA. La IA debe ser capaz de entender el lenguaje natural de las personas, es decir, debe disponer de procesamiento del lenguaje natural (PLN). La conversión de voz a texto y de texto a dirección debe ser una capacidad de la IA para permitir una conversación rica. Necesitamos sensores que detecten el movimiento, como el de un paciente que se cae de la cama, y que la IA active alertas. En el centro de la habilitación de este espacio inteligente en la UCI, necesitamos aprendizaje continuo. Todas estas funciones requieren aprendizaje automático. Pensar en la IA como una sola cosa o una sola máquina sería incorrecto. Por ejemplo, en la UCI, la IA formaría parte del entorno. Integrar la IA en altavoces de voz, sensores y otras cosas inteligentes que trabajan juntas proporciona una inteligencia similar a la humana que aumenta la capacidad de los médicos. Sabemos que los pacientes recuerdan menos del 50% de las comunicaciones con sus médicos durante la interacción médico-paciente.2 Ahí radica una de las muchas oportunidades de utilizar la IA para mejorar las interacciones médico-paciente.

La Pila de IA puede comprender tanto una pila de hardware como de software, un conjunto de componentes subyacentes necesarios para crear una solución completa. Utilizando la Pila de IA de la Figura 1-1 como guía, las siguientes secciones ofrecen una breve introducción a las capacidades de la IA, empezando por el aprendizaje automático y las redes neuronales.

Aprendizaje automático y redes neuronales

Existen diferentes tipos o subcategorías de aprendizaje automático, como el aprendizaje supervisado, el aprendizaje no supervisado y el aprendizaje profundo.

En el aprendizaje supervisado, entrenamos al ordenador utilizando datos etiquetados. Si queremos que un modelo ML detecte a la madre de un niño, le proporcionamos un gran número de fotos de la madre, etiquetando cada foto como "la madre". O si queremos que un modelo ML detecte una neumonía en una radiografía, tomamos muchas radiografías de neumonía y etiquetamos cada una como tal. En esencia, etiquetamos los datos con la respuesta correcta. Es como tener un supervisor que te da todas las soluciones correctas para tu prueba. Un algoritmo de aprendizaje automático supervisado aprende a partir de datos de entrenamiento etiquetados. En efecto, supervisamos el entrenamiento del algoritmo. Con el aprendizaje automático supervisado, utilizamos un ordenador para identificar, clasificar y categorizar cosas. Si tenemos que examinar miles de radiografías para identificar una neumonía, probablemente realizaremos esta tarea más rápidamente con un ordenador que utilice el aprendizaje automático que con un médico. Sin embargo, que el ordenador supere al médico en esta tarea no significa que el ordenador pueda hacerlo mejor que un médico en la atención clínica.

Gran parte del aprendizaje que hacemos como humanos es no supervisado, sin el beneficio de un maestro. No damos las respuestas a los modelos de aprendizaje no supervisado, y ellos no utilizan datos etiquetados. En su lugar, pedimos al algoritmo, al modelo, que descubra la respuesta. Aplicando esto al ejemplo de la madre del niño, proporcionamos al algoritmo de reconocimiento facial características, como el tono de la piel, el color de los ojos, la forma de la cara, los hoyuelos, el color del pelo o la distancia entre los ojos. El aprendizaje automático no supervisado reconoce los rasgos únicos de la madre del niño; aprendiendo de los datos, identifica a "la madre" en las imágenes con gran precisión.

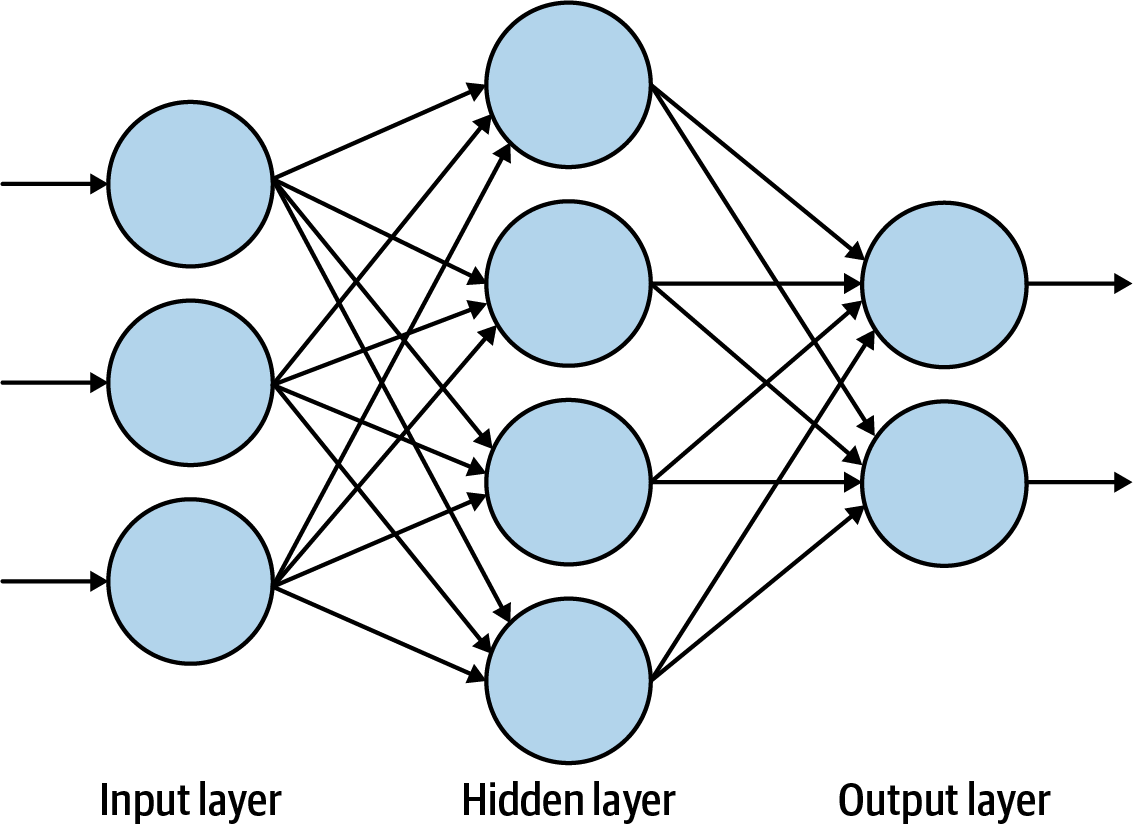

El aprendizaje profundo utiliza una serie de algoritmos para obtener respuestas. Los datos alimentan un lado, la capa de entrada, y se mueven a través de la(s) capa(s) oculta(s), extrayendo información específica que alimenta la capa de salida, produciendo una idea. Describimos estas capas, o series de algoritmos, como una red neuronal. La figura 1-2 ilustra una red neuronal con tres capas. La salida de cada capa es la entrada de la capa siguiente. La profundidad de la red neuronal refleja el número de capas atravesadas para llegar a la capa de salida. Cuando una red neuronal consta de más de tres capas o más de una capa oculta, se considera profunda, y nos referimos a esta técnica de aprendizaje automático como aprendizaje profundo. A menudo se dice que la red neuronal imita el funcionamiento del cerebro humano, pero la realidad es que la red neuronal es un intento de simular la red de neuronas que componen un cerebro humano para que las máquinas puedan aprender como los humanos.

Figura 1-2. Ilustración de una red neuronal

La red neuronal permite ajustar los parámetros hasta que el modelo proporciona la salida deseada. Como la salida puede ajustarse a nuestro gusto, es un reto "mostrar nuestro trabajo", lo que da lugar a la categorización de "caja negra". Nos preocupa menos cómo ha obtenido el modelo el resultado y, en cambio, nos centramos en obtener sistemáticamente el mismo resultado. Cuantos más datos avanzan por la red neuronal, menos probable es que podamos precisar exactamente por qué funciona el modelo, y nos centramos en la precisión del modelo.

Las personas y las máquinas aprenden de forma diferente. Enseñamos a las máquinas a identificar determinadas imágenes como un tumor con algoritmos predefinidos utilizando datos etiquetados (por ejemplo, tumor o no tumor). Un niño puede reconocer a su madre con un entrenamiento mínimo y sin muchas imágenes de su madre y de personas que no son su madre. Pero una máquina necesita suficientes datos (por ejemplo, tumor/no tumor) para desarrollar la "habilidad" de aprender si una imagen es "la madre".

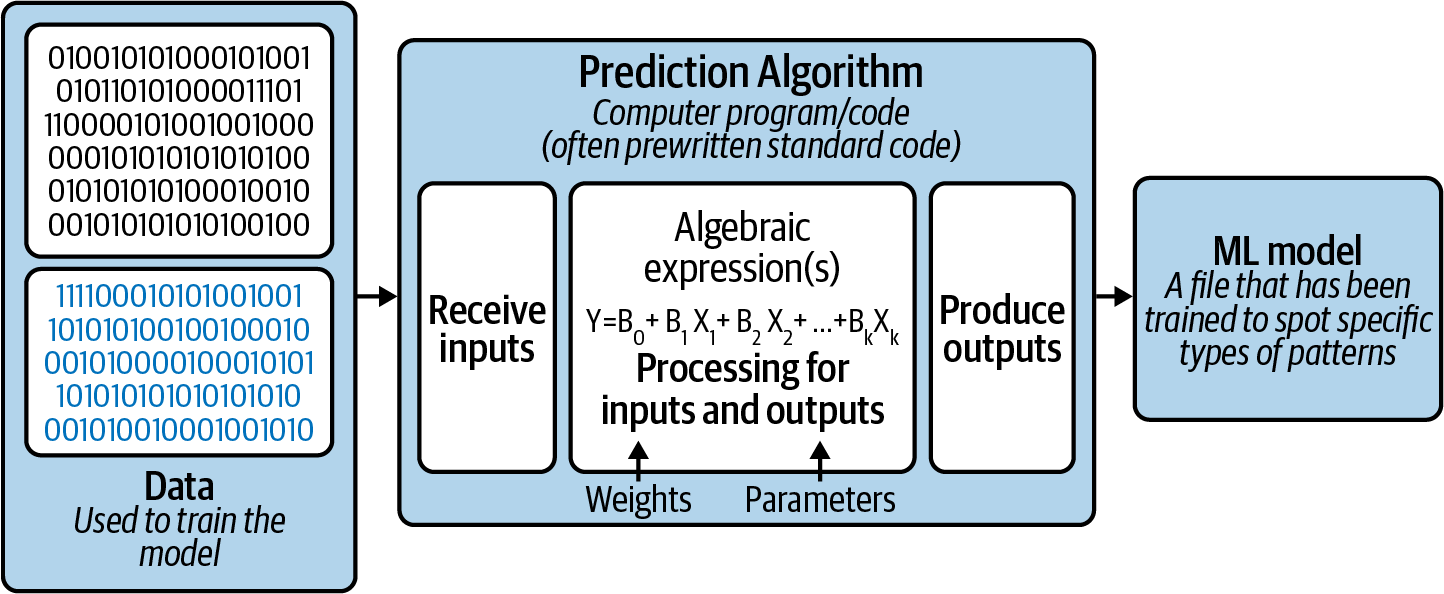

Un modelo de aprendizaje automático, a menudo descrito como algoritmo de forma sinónima pero inexacta, aprende de los datos. Estos algoritmos se implementan en código. Los algoritmos son sólo las "reglas", como una expresión algebraica, pero un modelo es una solución. Los algoritmos de aprendizaje automático son mecanismos diseñados que hacen pasar las entradas caracterizadas por la ingeniería a través de los algoritmos para obtener la probabilidad de los objetivos. La selección de opciones y el ajuste de hiperparámetros aumentan la precisión de los resultados del modelo y controlan los errores de modelización. Los datos se dividen en datos de entrenamiento y datos de prueba, utilizando los datos de entrenamiento para construir un modelo y los datos de prueba para validar el modelo. La validación cruzada es necesaria antes de la implementación del modelo en producción, para asegurarse de que los nuevos datos obtendrían un resultado similar. La figura 1-3 ilustra un modelo de regresión simple. Esta figura muestra una relación lineal con la variable Y objetivo a partir de las características x1, x2, ... utilizadas en el modelo. Un primer paso consiste en definir el objetivo a predecir, encontrar la fuente de datos para realizar la ingeniería de características, que identifica las variables relacionadas, y probar los distintos algoritmos para que se ajusten mejor a los datos y al objetivo. Se utiliza un mecanismo de puntuación llamado puntuación F1 para validar el rendimiento del modelo.

Figura 1-3. Modelo ML

Un ejemplo fácil de entender es cuando nuestro correo electrónico se clasifica en categorías como "spam" y "bandeja de entrada". Podríamos escribir un programa informático con sentencias If/Then/Else para realizar la clasificación, pero este enfoque artesanal llevaría tiempo; también sería frágil, porque lo que constituye spam cambia constantemente, así que tendríamos que actualizar continuamente el programa informático con más sentencias If/Then/Else a medida que aprendiéramos más sobre nuevos correos electrónicos spam. Los algoritmos de aprendizaje automático pueden aprender a clasificar los mensajes de correo electrónico como spam o bandeja de entrada entrenándose con grandes conjuntos de datos que contengan spam.

Una vez que estamos satisfechos de que el modelo funciona con distintos datos, incorporamos el modelo o archivo y lo enchufamos a un flujo de trabajo o producto como el correo electrónico o una herramienta de predicción de enfermedades. El modelo puede manejar nuevos datos sin ninguna codificación manual, y el modelo es utilizado por diferentes usuarios que utilizan el producto de correo electrónico. En este ejemplo del correo electrónico, etiquetamos datos, lo que es aprendizaje supervisado.

Visión por ordenador y procesamiento del lenguaje natural (PLN)

La visión por ordenador (VC), un subcampo de la IA, trata de ayudar a los ordenadores a comprender el mundo visual. El mundo visual en la asistencia sanitaria abarca muchas cosas; una breve (e incompleta) lista incluye:

-

Imágenes fijas, como radiografías para detectar neumonías

-

Fotografías que muestren lesiones cutáneas

-

Sensores que detectan movimientos como caídas o actividades dentro de una vivienda

-

Faxes de notas clínicas manuscritas

-

Vídeos que muestran posibles problemas de salud

La visión por ordenador permite a las máquinas ver y comprender estos elementos visuales y, a continuación, reaccionar. A menudo, el aprendizaje automático facilita la identificación y clasificación de los objetos.

El procesamiento del lenguaje natural, o PNL, dota a las máquinas de la capacidad de leer y comprender las lenguas humanas. Comprender y generar el habla (es decir, escribir y hablar) es esencial para la inteligencia humana. El PNL permite a los ordenadores leer notas clínicas, analizar palabras clave y frases, y extraer su significado para que las personas puedan crear y utilizar perspectivas procesables. La PNL puede ser útil para extraer elementos vitales de las interacciones médico-paciente y automatizar la población de contenidos en las historias clínicas electrónicas.

Planificación y razonamiento

Los humanos planifican como parte natural de sus vidas. Resolver muchos problemas sanitarios requiere que la IA realice un componente de planificación. La planificación y el aprendizaje automático funcionan de forma complementaria para resolver problemas difíciles. Cuando Google creó el programa informático AlphaGo para vencer a uno de los mejores jugadores de estrategia del mundo en el juego de mesa Go, el programa utilizó la planificación y el aprendizaje. En el juego, AlphaGo utilizó un modelo de simulación, Monte Carlo, y aprendizaje profundo para predecir la probabilidad de resultados específicos. En este ejemplo, el ordenador debe actuar de forma autónoma y flexible para construir una secuencia de acciones para alcanzar un objetivo. Utiliza el aprendizaje automático y técnicas como los algoritmos computacionales, también conocidos como Monte Carlo, para determinar su siguiente movimiento. La planificación puede adoptar la forma de lógica If/Then/Else o algoritmos, lo que haga falta para diseñar un sistema inteligente necesario para resolver un reto.

Otro aspecto de la planificación aborda el reto de la caja negra del aprendizaje profundo. El hecho de que no podamos explicar cómo un modelo alcanza sistemáticamente, digamos, un 95% de precisión, no se traduce en que no podamos explicar los resultados de la IA. Puede que el rendimiento del modelo no consiga la adopción clínica, pero la transparencia del modelo nos acerca a ese objetivo final, y esto forma parte de la planificación de la IA. Como todos los campos de la IA, la IA interpretable es un área de investigación en la que las empresas de nueva creación y los investigadores trabajan para eliminar las conjeturas de la IA.

Además de la planificación, muchas soluciones de IA deben tener un elemento de razonamiento. Las máquinas hacen inferencias utilizando datos, que es una forma de razonamiento. Los primeros investigadores en el campo de la IA desarrollaron algoritmos y utilizaron reglas If/Then/Else para emular el sencillo razonamiento paso a paso que utilizan las personas para resolver problemas y hacer inferencias lógicas. Los primeros motores de inferencia y sistemas de apoyo a la toma de decisiones de los años 60 utilizaban este tipo de técnicas.

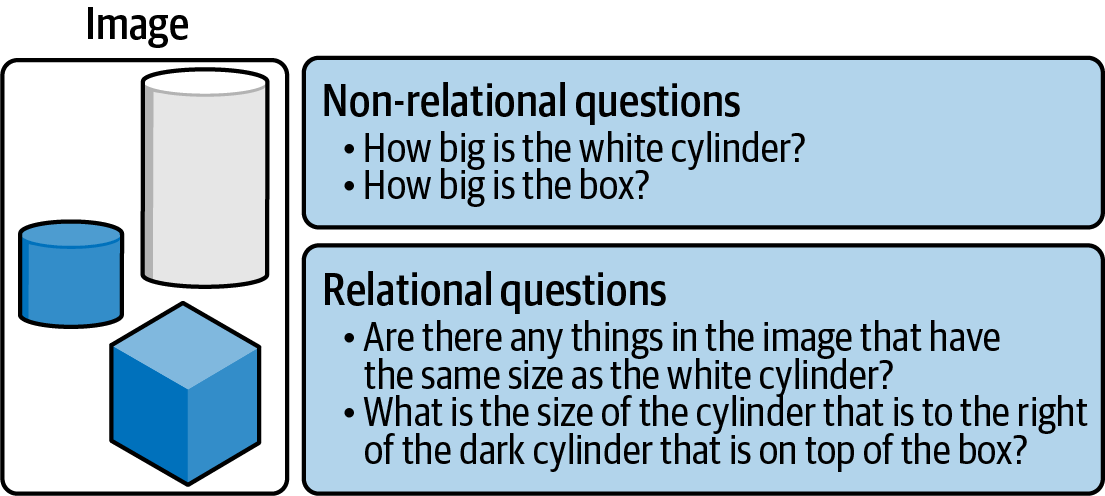

El aprendizaje automático realiza muchas tareas humanas mejor que los humanos, pero no el razonamiento. La Figura 1-4 muestra una imagen de dos cilindros de distintos tamaños y una caja. Cualquier niño de cinco años podría responder a las preguntas no relacionales y relacionales que se muestran en la imagen. Pero un ordenador que utilice el aprendizaje profundo no sería capaz de comprender las relaciones implícitas entre cosas diferentes, algo que los humanos hacen bastante bien.

Figura 1-4. Imagen de varios objetos

En junio de 2017, DeepMind publicó un artículo en el que mostraba una nueva técnica, las redes de relaciones, que pueden razonar sobre las relaciones entre objetos.3 El razonamiento de DeepMind utilizaba diversas técnicas de IA combinadas para obtener respuestas a preguntas relacionales. El desarrollo del razonamiento en la IA sigue siendo un campo de investigación en evolución. Las soluciones sanitarias que necesitan razonamiento tendrán en cuenta tanto las técnicas de IA antiguas como las nuevas, así como la investigación emergente.

Autonomía

Hay casos en los que queremos que la IA funcione por sí sola, que tome decisiones y actúe. Un ejemplo obvio es cuando la IA de un vehículo autónomo puede salvar la vida de un peatón. En sanidad, las personas que presentan reclamaciones desearían respuestas afirmativas instantáneas. Los sistemas autónomos de IA realizan tareas como aprobar reclamaciones o autorizar readmisiones, y la IA logra estos objetivos sin interactuar con los humanos. Los sistemas autónomos pueden funcionar de forma aumentada, respondiendo a las preguntas de los médicos o guiando a un médico en una tarea. Los niveles de autonomía en la asistencia sanitaria variarán, tomando como referencia los niveles de autonomía definidos para los vehículos.4 La autonomía en la IA no es una propuesta de todo o nada. La IA en la asistencia sanitaria no debe hacer daño y, en muchos casos, debe tener un nivel de cuidado superior al de la IA en los vehículos. La ingeniería de la autonomía en las soluciones sanitarias debe ser un proceso centrado en el ser humano. Los ingenieros no deben confundir la automatización, en la que la IA puede repetir sistemáticamente una tarea, con la autonomía de la IA. Los humanos deben permanecer en el bucle.

Interacciones entre humanos e IA

Otro principio clave de un enfoque AI-First es asegurarse de que los humanos estén siempre en el bucle. La IA no puede funcionar en el vacío; se necesitan personas para conservar y proporcionar datos, comprobar los sesgos de los datos, mantener los modelos de aprendizaje automático y gestionar la eficacia general de los sistemas de IA en la asistencia sanitaria. La IA no siempre funcionará bien -incluso puede salir terriblemente mal- y la experiencia y capacidad de reacción de los seres humanos serán fundamentales para la evolución de los sistemas de IA y su eficacia en los entornos clínicos y en la asistencia sanitaria en general.

Es asombroso pensar que la IA y el ML forman parte natural de nuestro léxico y son términos omnipresentes en todo el mundo. Está claro que ha habido un resurgimiento de la IA, y sigue extendiéndose. La siguiente sección explora la difusión de la IA.

Transiciones AI

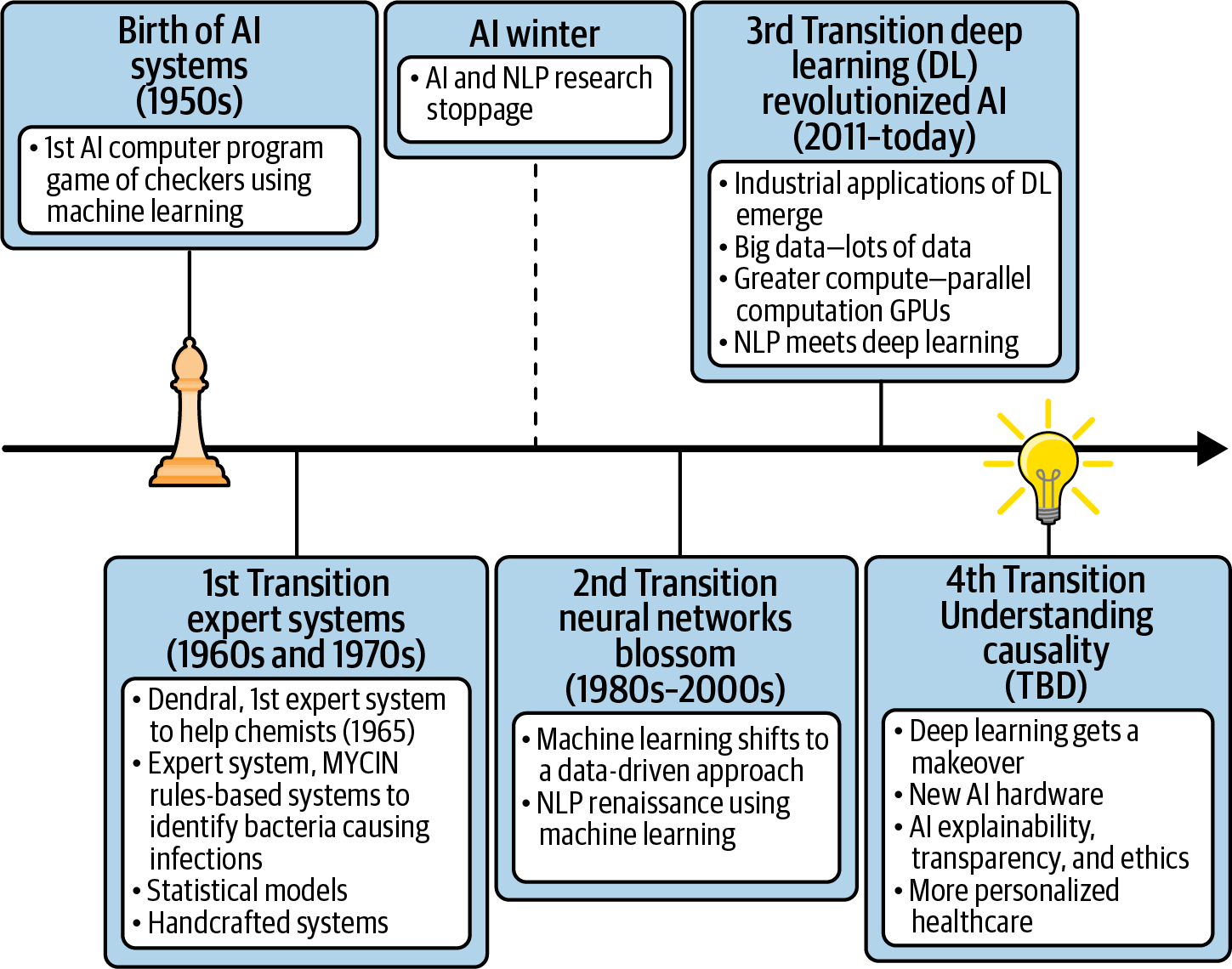

Las innovaciones en la IA le permiten dar pasos de gigante hacia el objetivo de imitar la inteligencia humana. La Figura 1-5 destaca las innovaciones clave que se convirtieron en transiciones para impulsar nuevas aplicaciones y soluciones de IA en la sanidad y otros sectores.

Figura 1-5. Transiciones de la IA

Arthur Samuel, pionero de la IA, desarrolló en 1952 un programa informático para jugar a las damas, que se considera el primer programa informático que aprende por sí mismo, elprimer programa de aprendizaje automático. En años posteriores surgieron los sistemas expertos y los sistemas de ayuda a la toma de decisiones, como MYCIN, CADUCEUS e INTERNIST-I, de los que ya hemos hablado.

Muchas de las actividades de principios del siglo XX en IA utilizaban la lógica de programación procedimental como técnica principal de programación y el levantamiento de pesas para proporcionar la infraestructura de apoyo. La muestra icónica de esta ola puede haber sido cuando el ordenador Deep Blue de IBM venció a uno de los grandes campeones intelectuales de la humanidad en ajedrez, Gary Kasparov. En aquel momento, pensamos que era una señal de que la inteligencia artificial estaba alcanzando a la inteligencia humana. El Deep Blue de IBM requería mucho trabajo; era un ordenador especializado, construido a propósito, que muchos describieron como una fuerza bruta tanto en el hardware como en el software. Merece la pena mencionar que uno de los programadores del Deep Blue, cuando se le preguntó cuánto esfuerzo se dedicaba a la IA, respondió "ningún esfuerzo". Describió el Deep Blue no como un proyecto de IA, sino como un proyecto que jugaba al ajedrez mediante la fuerza bruta de los ordenadores para hacer cálculos rápidos y desplazarse a través de las posibilidades.

El Invierno de la IA es una descripción metafórica del periodo de investigación y desarrollo de la IA que experimentó un nivel sustancialmente reducido de interés y financiación. El bombo y la exageración de la IA a principios del siglo XX resultaron contraproducentes, ya que la tecnología disponible no cumplió las expectativas. La IA algorítmica no trascendió a los humanos. La IA representada en las películas de ciencia ficción no era real.

En 1966, se interrumpió la financiación gubernamental de la investigación sobre PNL, ya que las traducciones automáticas eran más caras que utilizar personas. Los gobiernos cancelaron la investigación en IA, y a los investigadores en IA les resultó difícil encontrar trabajo. Fue un periodo oscuro para la IA, un invierno. Los fracasos en las entregas, los proyectos desbocados y los costes hundidos de los gobiernos y la industria condujeron al primer Invierno de la IA. La IA era un sueño, y se convirtió en una premisa aceptada que la IA no funciona. Este pensamiento continuó hasta que la analítica se convirtió en el apelativo. Nacieron las técnicas de aprendizaje automático y la analítica predictiva, y la segunda transición de la IA estaba en marcha.

¡En 2011, IBM volvió a hacer una demostración icónica de IA, cuando el sistema informático IBM Watson compitió en Jeopardy! contra los legendarios campeones Brad Rutter y Ken Jennings, ¡y ganó! Este sistema IBM Watson de 2011 tardó varios años en construirse, y de nuevo se utilizó la fuerza bruta en la implementación del hardware, mientras que se emplearon muchas matemáticas, aprendizaje automático y PNL en el lado de la ingeniería. Ni las unidades de procesamiento gráfico (GPU) ni las características de aprendizaje profundo de la IA del siglo XXI encontraron tracción alguna. Para el espectador ocasional, puede haber parecido que IBM Watson en Jeopardy! estaba haciendo IA conversacional, pero no era así, ya que IBM Watson no escuchaba ni procesaba audio. Más bien se transmitían archivos ASCII.

Para ser justos con IBM Watson y su sistema ganador de Jeopardy, su trabajo innovador en la comprensión del lenguaje natural hizo avanzar el campo.

Lo que podemos hacer hoy con la IA es, por supuesto, diferente de lo que podíamos hacer en los años 50, 60, 70, 80, 90 y principios del 2000. Aunque estamos utilizando muchos de los mismos algoritmos y gran parte de la misma ciencia informática, se ha producido una gran innovación en la IA. El aprendizaje profundo, los nuevos algoritmos, las GPU y las cantidades masivas de datos son diferencias clave. Se ha producido una explosión de nuevas ideas en la industria y en el mundo académico, y actualmente se está produciendo un renacimiento, en gran parte debido al aprendizaje profundo.

La demostración de las redes neuronales, los algoritmos de aprendizaje profundo y el alcance de la percepción humana en la comprensión de la vista, el oído y el lenguaje pusieron en marcha un tsunami de investigación y desarrollo de la IA en el mundo académico y las empresas tecnológicas. Internet proporcionó la veta madre de los datos, y las GPU la potencia de cálculo, y así llegó la tercera transición de la IA.

En octubre de 2015, el AlphaGo original se convirtió en el primer sistema informático en vencer a un jugador profesional humano de Go sin desventaja. En 2017, su sucesor, AlphaGo Master, venció al jugador mejor clasificado del mundo en una partida de tres juegos. AlphaGo utiliza el aprendizaje profundo y es otra muestra icónica de la IA. En 2017, DeepMind presentó AlphaZero, un sistema de IA que se enseñó a sí mismo desde cero a jugar y dominar los juegos de ajedrez y Go, y posteriormente venció a campeones mundiales. Lo sorprendente es que el sistema se construyó sin proporcionarle conocimientos de dominio: sólo las reglas del juego. También es fascinante ver un juego de ordenador con su propio estilo de juego, único, dinámico y creativo.5 AlphaZero muestra el poder de la IA.

Es muy posible (e incluso probable) que muchas empresas vean fracasar sus planes e implementaciones de IA. Las limitaciones del aprendizaje profundo y la IA son bien conocidas por investigadores, blogueros y varios expertos.6 Por ejemplo, el aprendizaje profundo no puede explicar por sí mismo cómo ha obtenido sus respuestas. El aprendizaje profundo no tiene causalidad y, a diferencia de los humanos, no permite el razonamiento humano, o lo que muchos describen como sentido común. El aprendizaje profundo necesita miles de imágenes para aprender e identificar objetos concretos, como determinar un tipo de gato o identificar a tu madre a partir de una foto. Los humanos sólo necesitan un puñado de ejemplos y pueden hacerlo en segundos. Los humanos saben que una imagen de una cara en la que la nariz está debajo de la boca no es correcta. Todo lo que se aproxime al razonamiento humano no es viable actualmente para la IA; ésa será la cuarta transición.

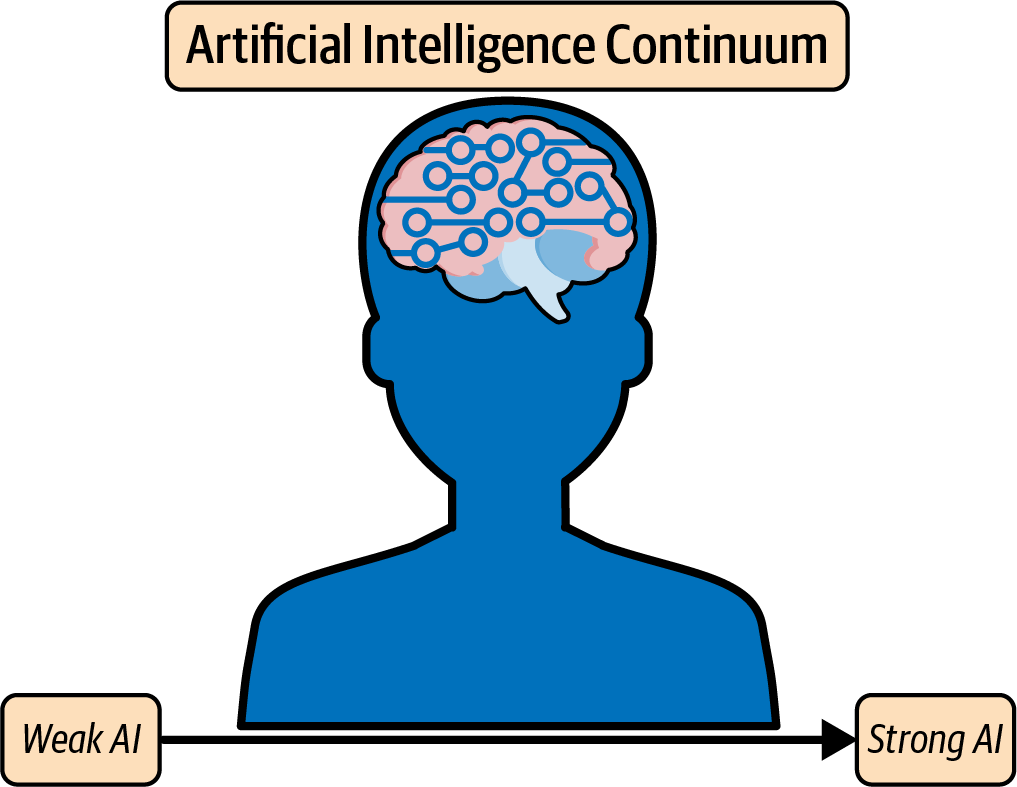

Se han hecho progresos asombrosos en la IA, pero aún queda mucho para que alcance el nivel de inteligencia humana. La investigación sigue haciendo avanzar la IA. La IA tiene aspiraciones, y se esfuerza por moverse lo más a la derecha posible en el Continuo de la Inteligencia Artificial, y lo más rápidamente posible, como se ilustra en la Figura 1-6.

A diferencia de películas como Ex Machina o 2001: Odisea del Espacio, en las que la IA supera a la inteligencia humana (lo que refleja una IA fuerte), aún no hemos llegado a ese punto -hoy tenemos una IA débil, o lo que algunos describen como IA estrecha. Es estrecha porque, por ejemplo, entrenamos modelos de aprendizaje automático para detectar neumonías, pero el mismo modelo no puede detectar cánceres tumorales en una radiografía. Es decir, un sistema entrenado para hacer una cosa se romperá rápidamente en una tarea relacionada pero ligeramente distinta. Hoy en día, cuando nos centramos en gran medida en problemas bien definidos para la IA, se necesitan personas para garantizar que la IA sea correcta. Los humanos deben entrenar los modelos de IA y gestionar el ciclo de vida del desarrollo de la IA desde la cuna hasta la tumba.

Figura 1-6. IA de débil a fuerte

Las nuevas innovaciones en IA nos desplazarán más a la derecha a lo largo del continuo, donde quizás la causalidad estará a nuestro alcance. Empezaremos a comprender, por ejemplo, si una aspirina tomada antes de un vuelo largo funciona realmente como anticoagulante, reduciendo el riesgo del sujeto de sufrir coágulos sanguíneos relacionados con la inmovilidad durante el viaje. Esto contrasta con la práctica actual de recomendar a los pasajeros de avión que tomen una aspirina como medida de precaución.

Lo más probable es que el aprendizaje profundo se renueve con nuevas investigaciones e innovaciones. El hardware mejorará. Habrá otra transición de la IA como las representadas en la Figura 1-5, y acelerará el movimiento de la IA más a la derecha a lo largo del continuo representado en la Figura 1-6. En la actualidad, la IA y los humanos deben trabajar codo con codo para resolver los problemas. La IA puede salir mal, y necesitamos clínicos con intuición y experiencia en la asistencia sanitaria aumentada con IA.

Tecnología de uso general AI-A

Además de ser un campo de estudio de la informática, la IA está demostrando ser una tecnología de propósito general (TGP ).7 Las GPT se describen como motores del crecimiento: impulsan el progreso tecnológico y el crecimiento económico. Es decir, un puñado de tecnologías tienen un efecto espectacular en las industrias durante largos periodos de tiempo. Las GPT, como la máquina de vapor, el motor eléctrico, los semiconductores, los ordenadores y ahora la IA, tienen las siguientes características:

-

Son omnipresentes: la tecnología es omnipresente, a veces invisible, y puede utilizarse en un gran número de industrias e innovaciones complementarias.

-

Generan innovación: a medida que una GPT mejora y se hace más omnipresente, extendiéndose por toda la economía, se obtienen más ganancias de productividad.

-

Son disruptivas: pueden cambiar la forma de trabajar de la mayoría de los sectores, si no de todos.

-

Tienen una finalidad general: realizan funciones genéricas, lo que permite su uso en una gran variedad de productos y servicios.

La dificultad para llegar a una definición única de inteligencia artificial radica en nuestros mismos desacuerdos sobre lo que constituye la inteligencia humana. El desarrollo de sistemas informáticos capaces de realizar actividades que normalmente requieren inteligencia humana también es una buena definición de IA, pero se trata de un listón muy bajo, ya que durante siglos las máquinas han realizado tareas asociadas a la inteligencia humana. Hoy en día, los ordenadores pueden hacer tareas que no pueden hacer los doctores y, al mismo tiempo, no pueden hacer tareas que pueden hacer los humanos de un año.

Contrariamente a las máquinas o robots nefastos que aparecen a menudo en películas como Blade Runner, Terminator y Yo, Robot, los ordenadores aparentemente sensibles y muy inteligentes no existen hoy en día. Eso sería la IA fuerte y general. Los ordenadores que buscan la singularidad tecnológica (donde la IA supera a la inteligencia humana) en películas distópicas como Matrix y Transcendence no existen.

Científicos de renombre mundial y "expertos en IA" suelen coincidir unánimemente en foros públicos en que es posible que las máquinas desarrollen una superinteligencia. Sin embargo, la cuestión que se plantea es si es teóricamente posible. La trayectoria de la IA sugiere que la posibilidad existe. Pero esto nos lleva a la paradoja de Moravec, que es una observación hecha por los investigadores de IA de que es fácil conseguir que los ordenadores muestren una inteligencia avanzada jugando al ajedrez o superando pruebas de inteligencia, pero es difícil que las máquinas muestren las habilidades de un niño pequeño cuando se trata de percepción y movilidad. La inteligencia y el aprendizaje son complicados. Aunque nos gusta poner las cosas en categorías, como "estúpida" o "inteligente", la IA se mueve a lo largo de un continuo, como se ilustra en la Figura 1-6; pero la IA actual no es "superinteligente", ni nadie tiene una línea temporal que nos ayude a comprender cuándo llegará el día de los ordenadores superinteligentes: podría ser dentro de cinco años o dentro de cien. La cantidad de recursos informáticos necesarios para demostrar las habilidades de bajo nivel que poseen los humanos refleja enormemente los retos que nos esperan para crear máquinas superinteligentes.

La IA se utiliza como abreviatura para describir un conjunto variado de conceptos, arquitecturas, tecnologías y aspiraciones, pero no existe una única tecnología de IA. La IA no es un sistema o producto integrado o utilizado por tales. Utilizamos el término IA en sentido amplio, ya que no se ha desarrollado ningún ordenador, máquina o IA con objetivos e intenciones similares a los humanos. Tampoco sabemos cómo construir un ordenador o máquina así, ya que, de nuevo, se trataría de una IA fuerte o general. Cuando hablamos de inteligencia humana, superinteligencia o sensibilidad en las máquinas, estamos hablando de un estado futuro. No existe una solución milagrosa para la IA; no podemos agitar una varita mágica de IA que arregle la sanidad o haga que la gente esté más sana.

Andrej Karpathy, investigador en ciencias informáticas y actual director de IA en Tesla, defiende enérgicamente que la IA cambia la forma en que construimos el software, la forma en que diseñamos las aplicaciones. Argumenta que la forma en que construimos el software -escribiendo instrucciones que indican al ordenador lo que debe hacer- es lenta y propensa a errores. Pasamos mucho tiempo depurando y, lo que es peor, el código se vuelve más frágil con el tiempo a medida que más personas lo mantienen, lo que a menudo resulta en un gran espagueti de código difícil de cambiar. La aplicación encierra a la empresa en una forma de hacer el trabajo.

La sanidad está plagada de software heredado y/o aplicaciones complejas que son tan grandes que ellas mismas se convierten en impedimentos para la innovación. Mediante el aprendizaje automático, podemos programar con ejemplos, es decir, podemos recopilar muchos ejemplos de lo que queremos que haga o deje de hacer la aplicación o el software, etiquetarlos y entrenar un modelo para que aprenda eficazmente a automatizar el propio desarrollo de la aplicación o el software. Aunque están empezando a aparecer herramientas para automatizar aspectos de la ingeniería de software, se necesita más innovación y más herramientas. Karpathy describe esta visión como Software 2.0. Además, pocas empresas, por no decir ninguna, tienen el talento o las herramientas para poner en práctica esta visión. Pero aún podemos utilizar el aprendizaje automático en lugar de la ingeniería manual para muchos de los problemas actuales, lo que nos permitirá preparar los sistemas para el futuro utilizando el aprendizaje automático a medida que aprendan con nuevos datos y evitar que los programadores escriban más código.

Comprender y explorar los mitos de la asistencia sanitaria y la tecnología de la IA ilumina nuestra comprensión y definición de la IA. Esto será clave para comprender los conceptos presentados en capítulos posteriores. A continuación, centraremos nuestra atención en debatir algunos mitos clave de la IA sanitaria .

Mitos de la IA en sanidad

Hay mucho entusiasmo en torno a la IA en la sanidad, pero ¿qué se supone que soluciona exactamente la IA en la sanidad? La gente espera que la IA prediga enfermedades futuras, las prevenga, mejore el tratamiento de las enfermedades, supere los obstáculos al acceso a la asistencia sanitaria, resuelva el problema de los médicos sobrecargados de trabajo y agotados, y mejore la salud de las personas en general, reduciendo al mismo tiempo el coste de la asistencia sanitaria. Aunque parte de esto es factible, la IA no es una panacea milagrosa para todos los problemas relacionados con la salud y la asistencia sanitaria. Si la IA no se aplica con criterio, con supervisión y visión humanas, los errores o las recomendaciones incorrectas basadas en datos y suposiciones defectuosos o inadecuados pueden acabar con la confianza que se pretende lograr con los usos de la IA en la asistencia sanitaria. La IA en la asistencia sanitaria debe aplicarse con el propósito correcto, con la revisión de los riesgos potenciales en la mente de los desarrolladores.

Roy Amara, anterior director del Instituto para el Futuro, acuñó la Ley de Amara, que afirma: "Tendemos a sobrestimar el efecto de una tecnología a corto plazo y a subestimar el efecto a largo plazo". Uno de los principales mitos relativos a la IA es que ésta sustituirá a los médicos y otros profesionales sanitarios. La IA se apoya en la base de conocimientos proporcionada por médicos formados y experimentados. La IA no puede sustituir el aspecto "asistencial" de la interacción humana y su efecto terapéutico documentado. La IA no tiene la capacidad de determinar la mejor solución cuando una revisión holística de un paciente recomendaría un enfoque basado en la creatividad, el juicio y la perspicacia humanas. Por ejemplo, pensemos en un paciente de 90 años, por lo demás sano, que desarrolla un cáncer eminentemente tratable. La lógica y la medicina actual apoyarían un tratamiento agresivo para destruir el cáncer. El aspecto humano entra en juego cuando este mismo paciente hace saber a su médico que es viudo y está solo, y aunque no está deprimido, siente que ha vivido una vida plena y, por tanto, rechaza el tratamiento. AI y la mayoría de los médicos abogarían por el tratamiento. La revisión holística de los deseos del paciente y su autonomía en sus decisiones sanitarias tienen prioridad en este caso, y una agencia autónoma de IA que funcionara sin supervisión humana no las habría tenido en cuenta. Como este paciente estaría eligiendo un curso de acción que implica la inacción, y las características de lo que se incluye en la determinación del paciente de una vida plena no se incluyen en los modelos existentes, es poco probable que la IA pueda predecir esta decisión inusual pero válida del paciente.

La IA puede aplicar estrategias contraintuitivas a la gestión sanitaria, pero los pasos que van de los datos brutos a la decisión son complejos y necesitan percepciones y puntos de vista humanos. El proceso es una progresión, que comienza con datos clínicos obtenidos de innumerables fuentes que se construyen y desarrollan para convertirse en información relevante, que luego se utiliza y aplica a poblaciones y/o individuos. La transformación de los datos brutos en conocimientos e inteligencia es un proceso guiado por clínicos que trabajan con científicos de datos que utilizan IA. La interpretación clínica de los datos depende de los humanos y de su comprensión de los procesos de la enfermedad y su efecto en la línea temporal de la progresión de la enfermedad que moldea este conocimiento inicial. Los algoritmos para la gestión de la enfermedad, la identificación de factores de riesgo que predicen la probabilidad de desarrollo de la enfermedad, se basan en la comprensión e interpretación humanas del proceso de la enfermedad y del estado humano. El uso de la IA y las actividades de los médicos están entrelazados, y juntos su potencial para mejorar la salud es notable. Como hay tantos usos potenciales de la IA en la asistencia sanitaria, podemos desglosarlos en algunas de las numerosas lagunas identificadas anteriormente:

- Acceso desigual a la asistencia sanitaria

La IA puede utilizarse para evaluar los determinantes sociales de la salud que pueden predecir qué poblaciones están "en riesgo" o identificadas para la infrautilización de la asistencia, y entonces pueden desarrollarse planes tácticos para abordar mejor estas lagunas en el uso médico.

- Insuficientes servicios sanitarios a la carta

La IA ya está abordando algunas de estas necesidades con aplicaciones como Lark Health, que gestiona utilizando dispositivos inteligentes e IA con aprendizaje automático profundo para gestionar pacientes con enfermedades crónicas en buen estado, en riesgo y estables fuera del sistema sanitario.

- Costes elevados y falta de transparencia de precios

La IA puede utilizarse para predecir qué pacientes o poblaciones corren el riesgo de convertirse en "de alto coste", y un análisis posterior dentro de estas poblaciones puede identificar factores sobre los que intervenir para evitar este resultado.

- Residuos significativos

La incorporación de la IA a los sistemas de pagadores sanitarios es frecuente hoy en día. Se están eliminando las tareas administrativas y el papeleo innecesario para el paciente y el proveedor, haciendo que su experiencia de usuario sea mucho mejor.

- Sistemas de pagadores y proveedores fragmentados y aislados

La IA tiene un uso potencial aquí, como en la codificación automática de las visitas a la consulta y la posibilidad de deducir automáticamente el coste de las pruebas/exámenes/visitas de la cuenta de ahorros sanitarios de cada uno.

- Elevadas fricciones empresariales y malas experiencias de los consumidores

Los usos de la IA ya incluyen la facilitación del pago de reclamaciones a tiempo y la comunicación de las prestaciones sanitarias de un individuo, con menos errores y menor tiempo de procesamiento en comparación con los sistemas dominados por los recursos humanos.

- Registro congelado desde los años 60

Las historias clínicas electrónicas y la cantidad de datos de pacientes disponibles para las aplicaciones de IA, que pueden procesar estos datos y extraer ideas del análisis de la población, siguen creciendo y desarrollándose constantemente.

- Lenta adopción de los avances tecnológicos

La IA no puede ayudarnos aquí. Una vez más, es necesaria la aplicación juiciosa de la IA a las lagunas de la asistencia sanitaria. El uso de la IA en la asistencia sanitaria debe ser para ampliar las capacidades de los proveedores, facilitar el acceso de los pacientes a la asistencia sanitaria y su uso, etc. Lo que la IA no puede responder es cómo aceptaremos los humanos las soluciones basadas en la IA. La IA se utiliza de forma discreta en la asistencia sanitaria en su mayor parte, debido al escepticismo de pacientes y proveedores y a la resistencia al cambio. A medida que pasa el tiempo, y con emergencias nacionales e internacionales como la pandemia de COVID-19, la gente se ve obligada a aceptar e incluso a abrazar la mejora tecnológica de la asistencia sanitaria. Para continuar esta tendencia, tenemos que basarnos en el éxito y la satisfacción de los usuarios con el producto y el proceso.

- Agotamiento del personal sanitario, con incapacidad de los médicos para mantenerse informados sobre los últimos avances en medicina, debido al volumen de datos que deben absorber.

La IA puede procesar los cientos de nuevos artículos de revistas sobre avances científicos y farmacéuticos que se publican a diario. También puede recopilar hallazgos relevantes sobre diversos temas, a petición de los proveedores, para que los pacientes puedan recibir los tratamientos médicos más avanzados y los diagnósticos pertinentes para su enfermedad. La IA puede utilizarse en tiempo real para determinar si se puede conceder a un paciente una autorización previa para una prueba/procedimiento o un medicamento. Todos estos avances conducen a un aumento de la satisfacción de los usuarios con su experiencia sanitaria, a la disminución de los retrasos en la atención, a la eliminación del despilfarro de tiempo y recursos, a la mejora de los resultados sanitarios de los pacientes y a un aumento del tiempo de los médicos para estar con sus pacientes y no en sus tabletas.

Estos son sólo algunos ejemplos del uso actual de la IA en la sanidad.

A lo largo de este libro se abordarán otras capacidades con desarrollo en curso y casos de uso futuros, así como aplicaciones adicionales de la IA para ayudar a remediar los problemas sanitarios mencionados desde distintos ángulos.

Pongamos un ejemplo duro. La industria sanitaria trata de abordar situaciones sanitarias de alto coste que repercuten en la salud de los pacientes. Un ejemplo es la mortalidad y morbilidad materna y fetal y los costes astronómicos asociados. Un paso inicial es recopilar tantos datos como sea posible para que se produzca el aprendizaje automático. Habría que etiquetar los datos de entrenamiento, desarrollar modelos, comprobar la precisión de los modelos y puntuar los datos en los que se desconoce el resultado para identificar qué madres y bebés de un conjunto de población estarían en riesgo de desarrollar complicaciones durante o después del embarazo y correrían el riesgo de una estancia en la unidad de cuidados intensivos neonatales (UCIN). Esto implica el análisis mediante IA de todas las variables del paciente para aislar a la población objetivo. También es importante saber si hay otras afecciones en juego, como la hipertensión gestacional (y quizá sus manifestaciones más graves), que es muy prevalente y está asociada a los recién nacidos en la UCIN y a las complicaciones del embarazo.

El monitoreo rutinario de las mamás de riesgo desde una fase temprana permite a los clínicos intervenir con un diagnóstico y un tratamiento precoces de la hipertensión gestacional y sus manifestaciones para prevenir complicaciones y muertes maternas y fetales, con sus costes maternos y de UCIN asociados. La IA puede utilizarse para identificar a las madres de mayor riesgo, con el mayor impacto potencial de la intervención. La IA puede ayudar a los médicos a identificar la hipertensión gestacional y, a continuación, puede utilizarse en la gestión de la enfermedad, con terapias objetivo identificadas por los proveedores humanos y utilizadas para educar a las herramientas y productos de la IA. Podemos utilizar la IA para el análisis de estas madres y lactantes, a fin de determinar si existe una forma mejor de identificar, diagnosticar y tratar a esta población específica. La IA tiene ventajas inherentes y amplias aplicaciones, pero es la colaboración de la IA con la interfaz humana lo que permite que las herramientas de IA tengan tanto impacto. La IA no sustituirá a los profesionales sanitarios, pero es una poderosa herramienta para aumentar el trabajo de los médicos en la identificación y gestión de las enfermedades. Exploremos algunas de las formas en que la IA y los profesionales sanitarios han podido trabajar juntos, al tiempo que disipamos el mito de que la IA puede hacerlo todo por sí sola.

Mito: La IA curará las enfermedades

La IA no es un sustituto de una cura medicinal que pueda acabar algún día con las enfermedades (por ejemplo, la enfermedad coronaria y el cáncer); sin embargo, los avances en IA, la acumulación masiva de datos (es decir, big data) y el intercambio de datos en la asistencia sanitaria podrían conducir a lo que sí acaba con las enfermedades. Algunas personas creen que si la IA puede utilizarse para predecir quién corre el riesgo de padecer una enfermedad concreta, entonces podremos intervenir y cambiar comportamientos o iniciar un tratamiento que evite que la enfermedad llegue a presentarse. Por supuesto, ayudar a las personas a evitar que contraigan una enfermedad no es lo mismo que curar la enfermedad. Definir lo que entendemos por cura puede ser confuso, y esto nunca es más evidente que con enfermedades como el virus de la inmunodeficiencia humana (VIH). Magic Johnson, miembro del Salón de la Fama de la NBA, proclamó que se había curado del VIH porque los médicos no pudieron detectar el virus en su cuerpo tras un tratamiento continuado contra el VIH. Sin los medicamentos antirretrovíricos, el VIH habría aumentado y se habría vuelto a encontrar en el cuerpo de Johnson. ¿Estuvo alguna vez realmente curado? Para determinadas enfermedades, no está bien definida una posible curación. Sin embargo, prevenir una enfermedad para un individuo es mejor que intentar curarla.

La norma actual es que trabajemos para prevenir enfermedades, a menudo con el uso del aprendizaje automático. De forma rutinaria, las empresas sanitarias toman datos de las historias clínicas electrónicas (HCE), reclamaciones sanitarias, recetas, datos biométricos y otras muchas fuentes de datos para crear modelos de identificación de pacientes "de riesgo". Para que la prevención sea eficaz, los componentes de la asistencia sanitaria deben utilizar la inteligencia artificial para respaldar las decisiones y hacer recomendaciones basadas en la evaluación y las conclusiones de los médicos que prestan asistencia sanitaria a todos los pacientes.

El ecosistema sanitario está formado por consumidores que necesitan servicios sanitarios; médicos y proveedores que prestan servicios sanitarios; el gobierno, que regula la asistencia sanitaria; las compañías de seguros y otros pagadores que abonan los servicios; y los distintos organismos que administran y coordinan los servicios. En el estado ideal, estos componentes del ecosistema están sincronizados, optimizando la atención al paciente. Un ejemplo sencillo es la codificación médica, en la que la jerga médica no siempre se sincroniza con la terminología de codificación, lo que provoca lagunas en la atención a la hora de identificar el verdadero proceso de enfermedad de un paciente concreto. El sistema actual depende en gran medida de la codificación de los diagnósticos por parte de hospitales, proveedores, codificadores médicos y agentes de facturación. Este proceso de codificación médica ha mejorado a medida que vemos una mayor adopción de la IA, lo que aumenta la oportunidad de prevenir enfermedades.

La IA puede proporcionar a los clínicos más y mejores herramientas, aumentando la capacidad de diagnóstico de un clínico al analizar una imagen holística del paciente individual con flujos de datos más amplios y una comprensión tecnológica del proceso de la enfermedad y de quién está en riesgo y se verá más afectado. La IA se ha convertido en una herramienta más precisa para identificar enfermedades en imágenes, y con el auge de los espacios inteligentes (por ejemplo, hospitales, hogares, espacios de trabajo de los clínicos), la IA desencadena una fuente más viable de información diagnóstica. Examinaremos esto con más detalle en el Capítulo 3, en el que se analiza el mundo de las máquinas inteligentes y la informática ambiental y su impacto en la asistencia sanitaria. El volumen de flujos de datos hace que esto sea inmanejable para un humano, pero muy posible para las máquinas inteligentes apoyadas por la IA. Al identificar y estratificar a los individuos con mayor riesgo, la IA puede alertar a los médicos y a las empresas sanitarias para que intervengan y aborden los factores de riesgo modificables para prevenir la enfermedad.

Los algoritmos de IA, la medicina personalizada y los resultados predictivos de los pacientes pueden utilizarse para estudiar distintas enfermedades e identificar los tratamientos y resultados de las buenas prácticas, lo que aumenta la probabilidad de curar una enfermedad concreta. La IA puede analizar además si una población específica puede no responder a determinados tratamientos frente a otro y por qué. En 2014, el fiscal general de Hawai demandó a los fabricantes de un medicamento llamado Plavix8 (utilizado para diluir la sangre a fin de prevenir el ictus y el infarto de miocardio). La demanda alegaba que Plavix no funcionaba en una gran proporción de isleños del Pacífico debido a una deficiencia metabólica de esa población y que los fabricantes del medicamento conocían esta anomalía. Aunque el fabricante del medicamento no hubiera conocido esta diferencia genética en un principio, ya que no incluyó a los isleños del Pacífico en sus ensayos clínicos iniciales, sí fue consciente de la anomalía en la eficacia más tarde, durante el uso generalizado por parte de los pacientes. No se utilizaron algoritmos de IA para identificar el aumento de los malos resultados relacionados con el uso de Plavix como medicación preventiva en esta población. Pero la aplicación de la IA a un caso de uso de este tipo -es decir, el seguimiento de una población tras el lanzamiento de un medicamento para buscar puntos de aberración en los datos y luego sacar conclusiones de estos hallazgos- es un uso perfecto de la IA, que habría conducido a recomendaciones terapéuticas alternativas para los anticoagulantes con el fin de prevenir las complicaciones cardiovasculares y la recurrencia de la enfermedad de forma mucho más oportuna. La alternativa fue un proceso prolongado de varios años en el que los médicos observaron un hallazgo y luego lo comunicaron, y finalmente se llegó al hallazgo sobre la falta de eficacia de Plavix entre los isleños del Pacífico.

La aplicación de la IA al cáncer está suscitando un enorme interés, lo que nos lleva a pensar que podríamos reducir sustancialmente las muertes anuales por cáncer. Una gran proporción de nuestra población mundial desarrolla cáncer: sólo en 2018, unos 10 millones de personas murieron de cáncer en todo el mundo. Los datos de estas personas antes de desarrollar la enfermedad, después del diagnóstico y durante el tratamiento, junto con el uso de la IA, tienen el potencial de mejorar la atención oncológica y lograr más curaciones a partir del tratamiento. La incorporación de la tecnología de IA al tratamiento del cáncer acelera la velocidad de los diagnósticos, lo que conduce a una mejor toma de decisiones clínicas, que a su vez mejora los resultados de los pacientes de cáncer. La IA también puede ser útil en la gestión de las fases avanzadas del cáncer, gracias a la capacidad de predecir las necesidades de atención al final de la vida para facilitar la calidad de vida del paciente.

Un área en la que la IA puede tener un impacto significativo es la identificación del cáncer en los estudios radiológicos. La Facultad de Medicina Keck de la Universidad del Sur de California publicó en 2019 un estudio que mostraba una mejora en la detección del cáncer mediante IA.9 En concreto, "se realizó un estudio retrospectivo ciego con un panel de siete radiólogos utilizando un conjunto de datos enriquecido con cáncer de 122 pacientes que incluía 90 mamografías falsas negativas". Los resultados mostraron que todos los radiólogos experimentaron una mejora significativa en su tasa de detección de cáncer. La tasa media de detección de cáncer por los radiólogos aumentó del 51% al 62% con el uso de la IA, mientras que los falsos positivos (determinación de cáncer cuando en realidad no lo hay) se mantuvieron básicamente igual.

La detección precoz de estados de enfermedad tiene un enorme impacto positivo en el tratamiento y la curación en los resultados del cáncer, no sólo con los radiólogos, sino también con los dermatólogos. Científicos informáticos de Stanford crearon un algoritmo de detección del cáncer de piel mediante IA utilizando el aprendizaje profundo para la detección del melanoma maligno (una forma de cáncer de piel) y descubrieron que la IA identificaba los cánceres con tanta precisión como los dermatólogos. China ha utilizado la IA en el análisis de tumores cerebrales. Antes, los neurocirujanos realizaban la segmentación de tumores (utilizada en el diagnóstico del cáncer cerebral) manualmente. Con la IA, los resultados fueron precisos y fiables y crearon una mayor eficiencia. Siempre que una detección precoz y precisa pueda conducir a la curación, la IA tiene un lugar demostrado en el diagnóstico de los cánceres.

La IA sigue evolucionando en su uso y papel en la detección del cáncer. Actualmente, las mutaciones genéticas se determinan mediante análisis del ADN. La IA se utiliza ampliamente en empresas como Foundation Medicine (Roche) y Tempus para recomendar tratamientos para determinados genomas tumorales . Además, la IA se ha utilizado en radiogenómica, donde se utiliza el análisis de imágenes radiográficas para predecir rasgos genéticos subyacentes. Es decir, la IA se ha utilizado para analizar e interpretar imágenes de resonancia magnética (IRM) para determinar si existe una mutación que represente cáncer. En un estudio chino, el análisis mediante IA de las IRM predijo la presencia de glioma de bajo grado (tumor cerebral) en pacientes con una precisión del 83-95%. En la última década, la IA se ha aplicado al desarrollo de fármacos para el tratamiento del cáncer, y un estudio demostró la capacidad de la IA para predecir la probabilidad de fracaso en un ensayo clínico en el que se probaron más de 200 fármacos de muestra. Otro estudio aplicó la IA a la predicción de la respuesta de las células cancerosas al tratamiento.

Identificar y diagnosticar el cáncer en sus primeras fases, junto con un tratamiento asistencial adecuado, aumenta la oportunidad de curar a los pacientes de cáncer. La IA puede contribuir significativamente al diagnóstico de los pacientes basándose en señales o síntomas pasados por alto por la detección humana. La recopilación de datos de grandes grupos de población permite comprender y conocer los planes de tratamiento más eficaces. Esto conduce a un mejor tratamiento de los pacientes individuales basado en lo que se ha demostrado que son los planes de tratamiento más eficaces para otros pacientes que han tenido tipos similares de cáncer. Aquí es donde la IA -específicamente, los algoritmos de aprendizaje profundo que utilizan grandes conjuntos de datos que contienen los datos de millones de pacientes diagnosticados de cáncer en todo el mundo- podría desempeñar un papel importante. Desgraciadamente, todavía no existe el acceso y la acumulación de tales conjuntos de datos masivos. Las naciones tendrían que ponerse de acuerdo para compartir datos, mientras que dentro de los países los pacientes tendrían que conceder acceso general a sus datos privados; habría que construir sistemas tecnológicos para agregar todos estos datos dispares con diferentes medidas y normas. Todo ello conduce a que los agregados mundiales de datos sanitarios sean cosa del futuro. La capacidad tecnológica está ahí, pero la ética de tales conjuntos de datos y su uso puede prohibir su creación. Dicho esto, si se dispone de fuentes de datos suficientemente grandes para su análisis, la IA puede proporcionar a los médicos recomendaciones basadas en pruebas sobre los planes de tratamiento con mayores posibilidades de obtener resultados positivos.

Los errores humanos que provocan un retraso en el diagnóstico, o un diagnóstico erróneo, pueden ser cuestión de vida o muerte para los pacientes de cáncer; detectar el cáncer a tiempo marca la diferencia. La IA ayuda a la detección y el diagnóstico precoces aumentando las actuales herramientas de diagnóstico para los médicos. Una parte importante de la detección del cáncer de pulmón consiste en averiguar si hay pequeñas lesiones en los pulmones mediante tomografía computarizada (TC). Existe cierta posibilidad de error humano, y aquí es donde la inteligencia artificial desempeña un papel. Los clínicos que utilicen la IA podrían aumentar potencialmente la probabilidad de detección y diagnóstico precoces. Con los datos disponibles en relación con el cáncer y su tratamiento, la IA tiene el potencial de ayudar a crear una estructura a partir de estas bases de datos y extraer información relevante para orientar la toma de decisiones y el tratamiento de los pacientes en un futuro próximo.

Dar a los pacientes herramientas que les ayuden también ayuda a sus médicos; hablaremos de ello con más detalle en el Capítulo 3. Las herramientas que analizan rápidamente grandes cantidades de datos de pacientes para proporcionar señales que, de otro modo, podrían pasar desapercibidas, deberían desempeñar un papel cada vez más importante en la asistencia sanitaria, al igual que los algoritmos de aprendizaje automático que pueden aprender continuamente sobre un paciente. En el Capítulo 3 exploramos la sinergia entre unos pacientes cada vez más instrumentados, los médicos y la atención clínica. El cambio del uso mayoritario de ordenadores al uso de dispositivos que llevan los pacientes para la detección precoz de estados de enfermedad está muy avanzado. A pesar de la plétora de noticias aparentemente casi diarias sobre nuevos algoritmos de aprendizaje automático o nuevos dispositivos o productos de IA que mejoran la asistencia sanitaria, la IA por sí sola no solucionará los problemas sanitarios a los que se enfrentan las sociedades. Son muchos los retos que hay que resolver para que nuestro sistema sanitario funcione mejor, y la IA ayudará, pero disipemos el siguiente mito sobre que la IA por sí sola solucionará los problemas a los que se enfrenta la sanidad.

Mito: La IA sustituirá a los médicos

La IA no sustituirá a los médicos, ni ahora ni en un futuro próximo, a pesar de los muchos debates que sugieren que ocurrirá. En 2012, el empresario y cofundador de Sun Microsystems Vinod Khosla escribió un artículo con el provocativo título "¿Necesitamos médicos o algoritmos?", en el que afirma que los ordenadores sustituirán al 80% de lo que hacen los médicos. Vinod veía un futuro sanitario dirigido por empresarios, no por profesionales médicos.

Podemos considerar la IA como un sustituto del médico o como una mejora del médico. La IA puede realizar una doble comprobación y ver patrones entre millones de pacientes que un médico no podría ver. Un solo médico no podría ver a un millón de pacientes a lo largo de su vida, pero la IA sí. Podría decirse que el trabajo de diagnóstico realizado por un médico se centra en gran medida en el reconocimiento de patrones. Así que aumentar los diagnósticos con IA tiene sentido.

Los principales argumentos a favor de que la IA sustituya a los médicos son los siguientes:

-

La IA puede ser más precisa cada día, cada año, cada década, a un ritmo y a una escala imposibles para los médicos humanos.

-

La IA podrá explicar las posibilidades y los resultados con puntuaciones de confianza.

-

La IA puede mejorar el conjunto de conocimientos, aumentando la perspicacia de un médico (que quizá no esté formado en una especialidad concreta).

-

La IA puede ser la única forma de proporcionar acceso a la mejor asistencia sanitaria a millones de personas que no tienen acceso a servicios sanitarios o no pueden permitírselos.

Los argumentos en contra de que la IA sustituya a los médicos son los siguientes:

-

Los médicos humanos son mejores tomando decisiones en colaboración con otros humanos.

-

Los médicos tienen empatía, que es fundamental para la atención clínica.

-

Los médicos pueden establecer una conexión humana, que puede influir directamente en cómo se siente un paciente y puede facilitar que éste se adhiera a un plan de tratamiento.

-

La Revista de Ética de la AMA afirma que "el deseo de los pacientes de conexión emocional, tranquilidad y un toque curativo por parte de sus cuidadores está bien documentado".10

-

Los médicos pueden observar o detectar señales críticas gracias a sus sentidos humanos.

-

La IA aún no puede conversar con los pacientes del modo en que lo hace un médico humano.

-

Los factores subconscientes que pueden influir en la capacidad de tratamiento de un médico, si no se identifican explícitamente para la IA, se pasarán por alto.

El papel del radiólogo ha sido objeto de mucho escrutinio como un papel que la IA podría sustituir potencialmente. Merece la pena analizar algunas de las tareas que realiza un radiólogo y reconocer que la IA no podrá asumirlas, aunque podría aumentar la capacidad del radiólogo para realizar algunas de ellas:

-

Supervisar a residentes y estudiantes de medicina

-

Participar en proyectos de investigación

-

Realización del tratamiento

-

Ayudar a mejorar la calidad

-

Administrar sustancias para hacer visibles las estructuras internas en los estudios de imagen

-

Desarrollar o monitorear procedimientos de calidad

-

Coordinar los servicios radiológicos con otras actividades médicas

-

Asesorar a los pacientes radiológicos sobre aspectos como los tratamientos de riesgo o alternativos

-

Conversar con los médicos remitentes sobre los resultados de los exámenes o la información diagnóstica

-

Realización de procedimientos intervencionistas

Dicho todo esto, los radiólogos son el grupo con más probabilidades de ser considerado "sustituible" por la IA, ya que tienen un contacto directo nulo o mínimo con los pacientes, y no todos ellos realizan todas las tareas aquí enumeradas. Hay muchas tareas que la IA puede hacer mejor que un médico, pero rara vez o nunca la IA sustituirá procesos u operaciones empresariales enteros o una ocupación o profesión entera. Lo más probable es que, en un futuro previsible, los médicos pasen a manejar la IA sabiendo cómo utilizar las herramientas de la IA para prestar una atención clínica más eficaz y mejor. Actualmente, la IA ofrece muchas soluciones puntuales, y su oportunidad de mejorar los diagnósticos es significativa. Las vías de tratamiento e incluso muchos diagnósticos actuales requieren la toma de decisiones, algo para lo que la IA no es buena.

La IA y los médicos pueden trabajar en equipo porque es mucho lo que está en juego. La IA puede facilitar el aprendizaje activo (como mentor del clínico) prestando atención a aspectos que son muy inciertos y pueden contribuir potencialmente a un resultado positivo o negativo. La IA puede recibir comentarios y puntos de vista (como alumno del clínico) para mejorar en determinados aspectos.

Existe un problema práctico, y es que la IA debe vivir en nuestro mundo actual, en el que hay que superar varias barreras para que la IA sustituya a los médicos. Hoy tenemos una proliferación de sistemas que no se integran bien entre sí. Por ejemplo, un paciente que es atendido en un hospital, en un centro de atención urgente o en la consulta de un proveedor puede tener sus datos repartidos por varios sistemas diferentes con distintos grados de integración. La capacidad de un médico para navegar por el sistema sanitario y reunir estos datos dispares es fundamental para la atención al paciente.

La realidad es que no va a haber un ordenador, una máquina o una IA que resuelva la asistencia sanitaria, igual que no hay una solución única para todos los problemas de la banca, el comercio minorista o la fabricación. El camino hacia la digitalización difiere en función de la especialidad clínica y lo más probable es que se produzca proceso a proceso dentro de cada dominio o especialidad. Los sistemas de IA están aquí y en el horizonte para evaluar la salud mental, diagnosticar estados de enfermedad, identificar anomalías y mucho más.

Mito: La IA solucionará el "problema sanitario"

Sin duda, que la IA solucione los innumerables problemas de la asistencia sanitaria es un mito. En Estados Unidos, el sistema sanitario actual cuenta con un gran ecosistema de proveedores, sistemas de aseguradoras, pagadores y organismos gubernamentales que deben jugar bien juntos para aumentar el acceso a la asistencia sanitaria, reducir los costes, reducir el despilfarro y mejorar la atención. Por lo general, cuando los gobiernos hablan del "problema de la asistencia sanitaria", se refieren principalmente al gasto exponencialmente creciente de nuestra nación en asistencia sanitaria. La mayoría de las naciones siguen enfrentándose a una población envejecida que consume cada vez más recursos. La capacidad de la IA para superar los obstáculos al acceso a la asistencia sanitaria, resolver la carga de los médicos sobrecargados de trabajo y agotados, y mejorar la salud de las personas al tiempo que disminuye el coste de la asistencia sanitaria es posible, pero exagerada.

El Comité para un Presupuesto Federal Responsable informa de que Estados Unidos gastó más de 3 billones de dólares en gastos sanitarios en 2017, lo que equivale aproximadamente a 9.500 dólares por persona. La consultora Deloitte afirma que Estados Unidos gasta más per cápita en asistencia sanitaria que cualquier otro país del mundo, al tiempo que ostenta la desagradable distinción de ocupar los últimos puestos en mediciones objetivas, como el acceso, la eficiencia y la eficacia. Los costes administrativos están añadiendo una carga adicional al sistema sanitario, junto con el aumento de los costes sanitarios a medida que los avances médicos conducen a una longevidad prolongada y a los costes asociados del envejecimiento de la población.

Ni la tecnología ni la IA pueden solucionar todos estos problemas, así que, siendo realistas, la pregunta es: ¿cómo puede ayudar la IA a resolver algunos de los problemas de la asistencia sanitaria? En primer lugar está la cuestión del acceso, ya que el acceso a la asistencia sanitaria se compone de tres partes:

-

Acceder al sistema de asistencia (normalmente a través de las aseguradoras)

-

Tener acceso a un lugar donde se preste asistencia sanitaria (es decir, disponibilidad geográfica)

-

Tener acceso a un proveedor de asistencia sanitaria (número limitado de proveedores)